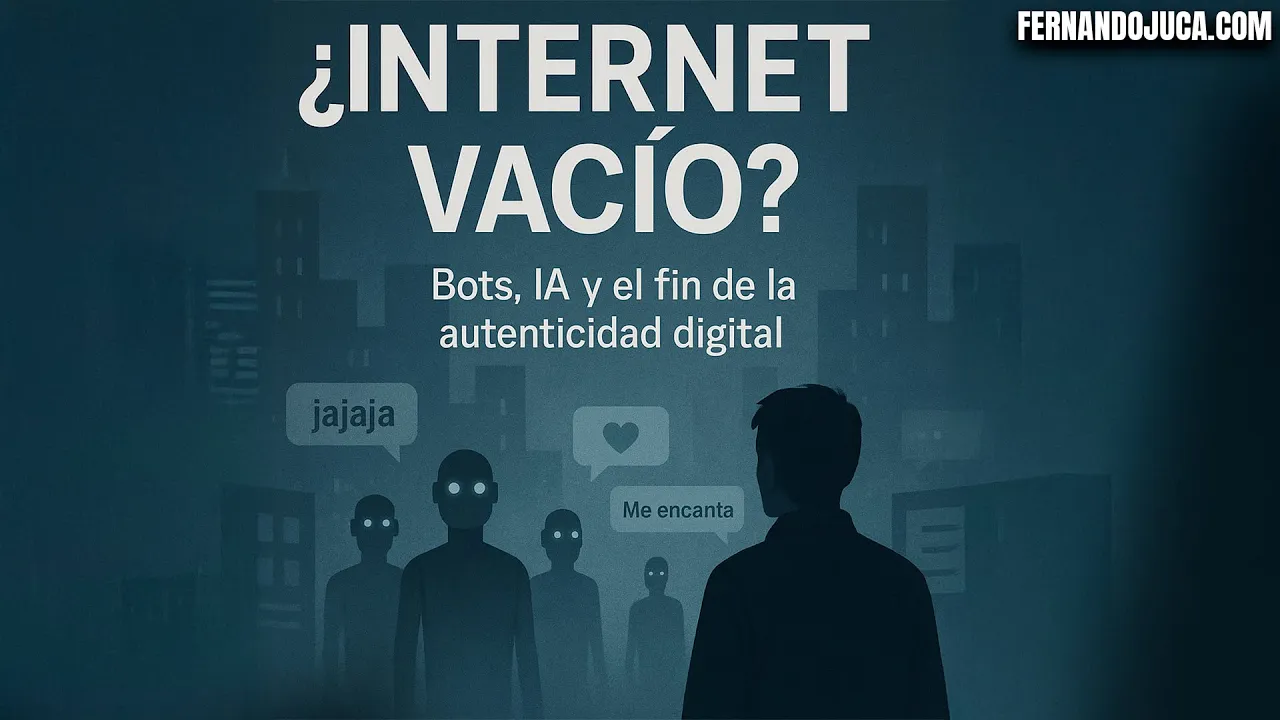

👻 ¿Qué es la teoría del Internet vacío?

La Dead Internet Theory, o “teoría del Internet vacío”, plantea una idea tan inquietante como provocadora: gran parte de la actividad online actual no la hacen humanos, sino bots .

Puede sonar a conspiración cyberpunk, pero el concepto ha estado circulando por foros desde hace años, y cada vez encuentra más resonancia. Según esta teoría, desde al menos 2017, muchas interacciones, publicaciones, “me gusta”, comentarios y hasta noticias son generadas por sistemas automáticos basados en inteligencia artificial.

Y no hablamos solo de bots de spam. Hablamos de granjas de contenido, cuentas falsas que simulan personas reales, y herramientas de IA que replican comportamientos humanos para generar contenido en masa, inflar métricas o manipular tendencias.

🌐 ¿Cuándo empezó todo?

Aunque el término se popularizó recientemente, la sospecha sobre un Internet lleno de bots no es nueva. En 2018, The Atlantic publicó un artículo titulado «The Internet Is Mostly Bots», donde ya advertía que más de la mitad del tráfico web era generado por programas automáticos. Y muchos de ellos, con fines maliciosos.

El periodista Max Read, en un artículo para NYMag, fue más allá: explicó que incluso en YouTube, el tráfico de bots era tan alto que se temía que los algoritmos empezaran a confundirlos con humanos… o viceversa.

🤖 ¿Y ahora con la IA generativa?

Con la llegada de ChatGPT, GPT-4, Claude, Gemini y otras herramientas de IA generativa, lo que antes parecía paranoia se está convirtiendo en una descripción plausible del presente.

Hoy, con unos pocos clics, puedes generar:

-

Comentarios automatizados para Reddit

-

Hilos falsos en X (Twitter)

-

Artículos que simulan ser de humanos reales

-

Contenido para TikTok y YouTube Shorts con avatares sintéticos

Y todo esto sin necesidad de saber programar. El acceso gratuito o barato a modelos de lenguaje ha democratizado la creación masiva de “contenido zombi”.

💬 El caso de X (antes Twitter): un cementerio de bots

X, la red social antes conocida como Twitter, es uno de los ejemplos más extremos del “Internet zombie”. El propio Elon Musk lo reconoció al intentar comprar la plataforma: acusó a la compañía de estar infestada de bots, y fue uno de los motivos que casi trunca la adquisición.

Hoy, los usuarios lo viven en carne propia:

-

Comentarios automatizados que “ríen” de videos silenciados cuya gracia era el audio.

-

Cuentas nuevas que publican masivamente sin interacción real.

-

Engagement inflado artificialmente para crear la ilusión de viralidad.

¿Quién interactúa con quién en realidad?

🧪 La IA que alimenta a la IA

Otro fenómeno curioso es que la IA se está entrenando con contenido generado por IA. Por ejemplo, durante meses Reddit mantuvo su API gratuita, lo que permitió a desarrolladores entrenar modelos conversacionales con hilos de discusión humanos.

Pero si esos hilos están llenos de slop o respuestas generadas por bots, el modelo termina entrenándose con su propio reflejo distorsionado. Es como una IA hablando consigo misma en un bucle infinito.

Esto plantea preguntas serias:

-

¿Qué pasa cuando una IA aprende de otra IA?

-

¿Dónde quedan los humanos en esa cadena?

-

¿Estamos enseñándole a los modelos a parecer humanos… usando contenido no humano?

🧠 ¿Y si esto ya no es teoría?

A día de hoy, no se puede demostrar que la mayoría de Internet esté desprovista de humanos, pero cada vez hay más evidencia anecdótica, estadística y técnica que respalda la idea de que una parte importante del contenido que consumimos no tiene alma.

Jason Koebler, de 404 Media, lo definió de forma memorable:

“Internet se está convirtiendo en un cementerio digital: bots riendo entre ellos, reaccionando a memes, compartiendo contenido que nadie pidió”.

Y la metáfora va más allá. No solo es un cementerio de bots, sino también de ideas. La repetición masiva de contenido sintético va vaciando la web de pensamiento original.

📉 ¿Por qué esto importa?

Porque si el contenido se convierte en ruido…

-

La búsqueda de información fiable se complica.

-

La conversación pública se degrada.

-

La creatividad queda ahogada por automatización.

Y porque empezamos a desconfiar de todo. ¿Esa reseña en Amazon es real? ¿Ese comentario en YouTube lo escribió una persona? ¿Ese artículo lo escribió un periodista… o un script?

🛠️ ¿Se puede salvar el Internet humano?

No todo está perdido. Hay señales de resistencia:

-

Wikipedia ha pausado sus pruebas con resúmenes de IA ante las críticas de sus editores.

-

Plataformas como Stack Overflow han prohibido respuestas generadas por IA sin verificación.

-

Creadores y periodistas independientes promueven una ética del contenido humano.

Pero se necesita más:

-

Etiquetado claro de contenido generado por IA

-

Educación digital para detectar automatismos

-

Valorar la voz humana frente a la eficiencia automática

❓Preguntas frecuentes (FAQ)

¿Todo el contenido generado por IA es malo?

No. El problema es cuando no hay supervisión, propósito o revisión. La IA puede ser una herramienta increíble en manos humanas responsables.

¿La teoría del Internet vacío está probada?

No es una teoría científica comprobada, pero muchos de sus postulados se han vuelto cada vez más realistas con el auge de la IA generativa.

¿Cómo saber si algo fue hecho por bots?

Fíjate en:

-

Lenguaje genérico o incoherente

-

Ausencia de autor

-

Interacciones sin sentido (como risas fuera de contexto)

-

Publicaciones repetidas con variaciones mínimas

🧭 ¿Navegamos solos?

Quizá no estemos tan solos en la red… pero sí más rodeados de máquinas de lo que imaginamos. Y eso plantea una pregunta urgente:

¿Queremos un Internet lleno de voces humanas o un eco interminable de frases generadas por software?

La respuesta está en nuestras manos, en nuestros clics y en nuestras decisiones digitales.