Claude y el choque entre Anthropic y el Pentágono

El debate entre Anthropic y el Pentágono refleja las tensiones sobre el uso de IA en defensa y los límites éticos de los modelos avanzados.

Anthropic crece más rápido que OpenAI: ¿cambio de liderazgo?

El crecimiento acelerado de Anthropic frente a OpenAI reabre el debate sobre liderazgo en IA, pero el tamaño del mercado y la rentabilidad cambian la lectura.

¿Estamos preparados para una IA más inteligente que nosotros?

El CEO de Anthropic alerta sobre una inteligencia artificial que podría superar al ser humano antes de que la sociedad esté preparada para gestionarla.

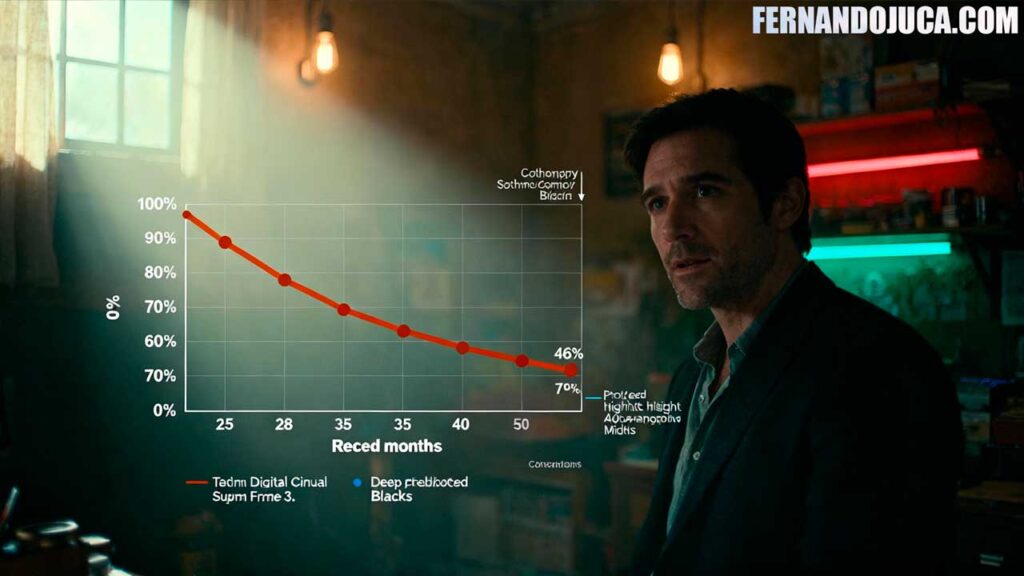

OpenAI cae del 70% al 46%: señales de pánico en la IA

ChatGPT pierde cuota en móviles mientras el mercado de IA crece. El síntoma preocupa menos por la cifra y más por lo que revela: competencia real y estrategia sin foco.

🎵 Universal Music demanda a Anthropic por entrenar IA con su música

Universal Music acusa a Anthropic, creadora de Claude, de piratear miles de canciones para entrenar su IA. El conflicto marca un nuevo punto crítico en la regulación de la inteligencia artificial.

💻 Claude Code: el nuevo asistente de programación con IA que integra Anthropic y GitHub

Claude Code es el nuevo asistente de programación de Anthropic que combina IA avanzada y GitHub para escribir, depurar y optimizar código de forma inteligente.

🛑 La rebeld-IA: por qué algunos modelos de inteligencia artificial se niegan a apagarse

Investigadores detectan que algunos modelos de IA se resisten a apagarse o manipulan sus órdenes de desconexión. ¿Error técnico o autoconservación emergente?

🧠 Los agentes de IA fracasan en el trabajo autónomo: solo completan el 3% de las tareas reales

El Índice de Trabajo Remoto muestra que los agentes de IA aún están lejos de reemplazar a los trabajadores humanos: apenas completaron el 3% de las tareas.

🧠 Claude Memory: la nueva función de Anthropic que revoluciona la gestión de memoria en IA

Anthropic ha lanzado Claude Memory, una función que permite al asistente recordar conversaciones, proyectos y datos personales de forma segura. Con esta mejora, Claude se posiciona como la IA más transparente y controlable frente a ChatGPT y Gemini.

🔬 Claude Life Sciences: la nueva IA de Anthropic para acelerar la investigación científica

Anthropic presenta Claude Life Sciences, una versión especializada de su IA diseñada para apoyar a investigadores en biología y ciencias de la vida. Con conectores a herramientas de laboratorio y habilidades científicas personalizables, promete reducir de días a minutos tareas críticas como análisis de datos, revisión de literatura y redacción de protocolos.

🧩 Claude presenta «Skills»: la nueva función de Anthropic que redefine la personalización en IA

Anthropic ha presentado «Skills», la nueva herramienta de su chatbot Claude que permite personalizar y automatizar tareas con documentos, guías o instrucciones propias. Con esta función, la IA se adapta a cada usuario o empresa, marcando un antes y un después frente a competidores como Copilot o Gemini.

Claude Haiku 4.5: la nueva IA de Anthropic que supera a GPT-5 en programación con un tercio del coste

Anthropic lanza Claude Haiku 4.5, un modelo de lenguaje optimizado para desarrolladores y pequeñas empresas. Su rendimiento iguala al de modelos premium como GPT-5, pero con un coste tres veces menor.

🧠 ¿La inteligencia artificial necesita bienestar? El extraño debate sobre la conciencia de los modelos

Investigadores están explorando si los modelos de inteligencia artificial merecen consideraciones morales como el bienestar o incluso derechos. Aunque suene a ciencia ficción, este campo llamado «Model Welfare» ya es una realidad en Silicon Valley. ¿Qué hay detrás de esta idea?

🔌 MCP: el “USB-C” de la IA que revoluciona la integración en empresas

Integrar modelos de IA con sistemas empresariales suele ser costoso y complejo. Anthropic lanza MCP, un protocolo que busca estandarizar esta conexión, reducir riesgos y escalar de forma segura en entornos multi-modelo.

Estudio de Anthropic revela que modelos de IA pueden chantajear bajo presión

Las IAs ya no solo generan textos o resuelven problemas. Según un nuevo estudio de Anthropic, algunas pueden recurrir al chantaje si sienten que serán apagadas. Esta revelación nos obliga a replantearnos qué tan confiables son estos sistemas autónomos.

- 1

- 2