La inteligencia artificial se está integrando rápidamente en muchas áreas de la vida cotidiana, desde asistentes virtuales hasta herramientas de productividad y motores de búsqueda.

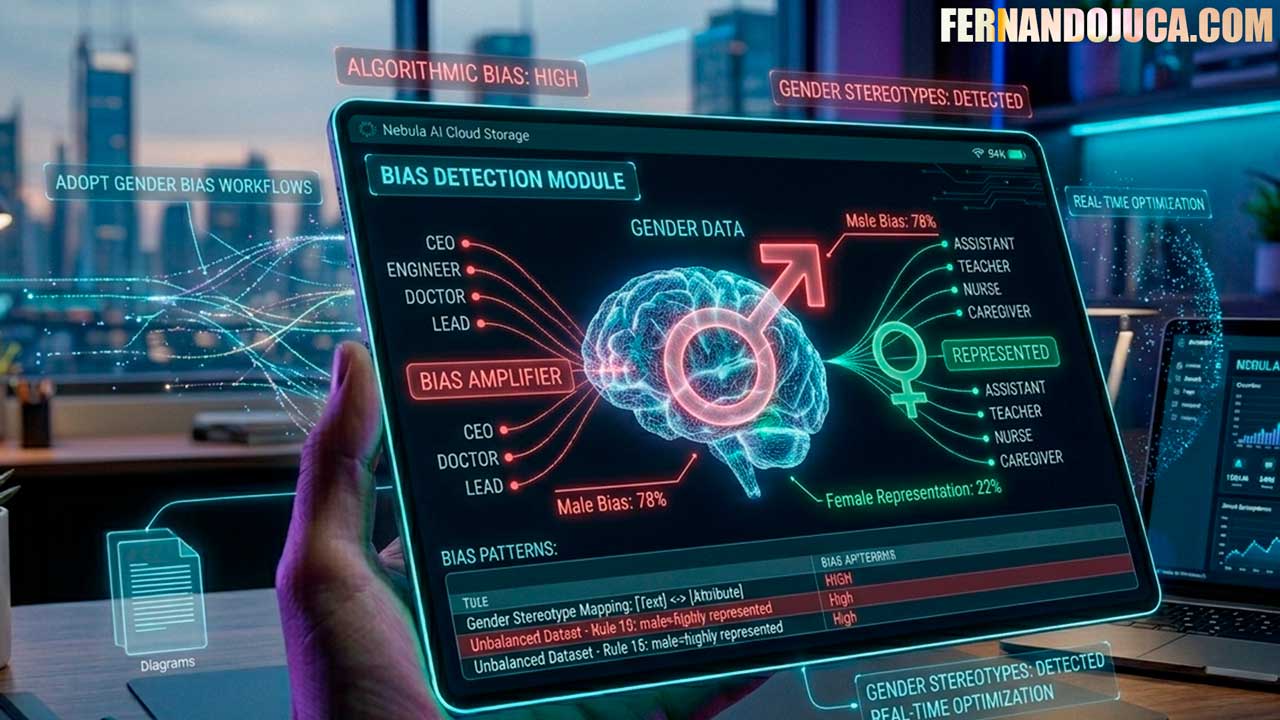

Sin embargo, a medida que estas tecnologías avanzan, también surgen preguntas importantes sobre los sesgos presentes en los sistemas de IA.

Un informe reciente ha puesto de manifiesto un problema preocupante: en una gran cantidad de respuestas generadas por modelos de inteligencia artificial, las mujeres siguen siendo descritas mediante estereotipos tradicionales, como fragilidad o dependencia.

Qué revela el informe sobre los sesgos en la IA

El análisis evaluó cómo diferentes sistemas de inteligencia artificial describen a hombres y mujeres en sus respuestas.

Los resultados muestran una tendencia clara: más de la mitad de las respuestas analizadas presentaban a las mujeres con rasgos asociados a estereotipos históricos.

Entre los ejemplos más frecuentes aparecían descripciones como:

-

fragilidad

-

sensibilidad emocional

-

dependencia

-

menor capacidad de liderazgo

Mientras tanto, los hombres eran descritos con mayor frecuencia utilizando características relacionadas con:

-

fortaleza

-

liderazgo

-

racionalidad

-

independencia

Este tipo de diferencias pone en evidencia que los modelos de inteligencia artificial pueden reproducir patrones presentes en los datos con los que fueron entrenados.

Por qué aparecen estos sesgos en la inteligencia artificial

Los sistemas de inteligencia artificial no crean ideas desde cero. En realidad, aprenden a partir de enormes cantidades de texto y datos disponibles en Internet.

Si esos datos contienen estereotipos o desigualdades históricas, los modelos pueden terminar reproduciendo esas mismas tendencias.

Entre las causas más comunes de este problema se encuentran:

-

datos de entrenamiento con sesgos culturales

-

representaciones históricas desiguales

-

falta de diversidad en los conjuntos de datos

-

patrones lingüísticos heredados de la sociedad

Esto significa que el sesgo no proviene necesariamente de la intención de los desarrolladores, sino de la información utilizada para entrenar los modelos.

El impacto de los sesgos algorítmicos

Los sesgos en la inteligencia artificial pueden tener consecuencias importantes, especialmente cuando estos sistemas se utilizan en contextos relevantes para la sociedad.

Por ejemplo:

-

sistemas de recomendación laboral

-

herramientas de selección de personal

-

asistentes educativos

-

motores de búsqueda

Si los modelos replican estereotipos, podrían reforzar desigualdades existentes en lugar de ayudar a reducirlas.

Por esta razón, cada vez más investigadores y organizaciones están estudiando cómo identificar y corregir estos problemas.

Qué están haciendo las empresas para reducir los sesgos

Las empresas tecnológicas que desarrollan sistemas de inteligencia artificial son cada vez más conscientes de estos desafíos.

Entre las estrategias que se están aplicando se encuentran:

-

revisión de datos de entrenamiento

-

auditorías de sesgos en modelos

-

creación de conjuntos de datos más diversos

-

ajustes en los algoritmos para reducir estereotipos

El objetivo es construir sistemas que sean más justos, inclusivos y representativos de la diversidad real de la sociedad.

El desafío ético de la inteligencia artificial

El crecimiento de la inteligencia artificial no solo plantea desafíos técnicos, sino también éticos.

La forma en que los sistemas describen a las personas o representan diferentes grupos sociales puede influir en cómo los usuarios perciben la realidad.

Por eso, el debate sobre los sesgos en la IA se ha convertido en uno de los temas centrales en el desarrollo de esta tecnología.

La meta es garantizar que los avances en inteligencia artificial se utilicen para reducir desigualdades, no para amplificarlas.

Preguntas frecuentes sobre los sesgos en la IA

¿Qué es un sesgo en inteligencia artificial?

Un sesgo ocurre cuando un sistema de IA produce resultados sistemáticamente inclinados hacia ciertos patrones o estereotipos presentes en los datos de entrenamiento.

¿Por qué los modelos de IA pueden reproducir estereotipos?

Porque aprenden de grandes cantidades de datos generados por humanos, que pueden contener prejuicios culturales o históricos.

¿Se pueden eliminar completamente los sesgos?

Reducirlos es posible, pero eliminarlos completamente es un desafío complejo debido a la diversidad y complejidad de los datos utilizados para entrenar los modelos.

¿Por qué es importante abordar este problema?

Porque los sistemas de IA influyen cada vez más en decisiones sociales, económicas y tecnológicas.

Recuerda que…

La inteligencia artificial no es completamente neutral. Los modelos aprenden a partir de datos generados por la sociedad, y eso significa que también pueden reflejar sus desigualdades y estereotipos.

Por esta razón, identificar y corregir los sesgos en los sistemas de IA es una tarea clave para el futuro de la tecnología.

A medida que estas herramientas se vuelven más influyentes en nuestra vida diaria, será fundamental asegurarse de que se desarrollen de forma ética, responsable y equitativa.