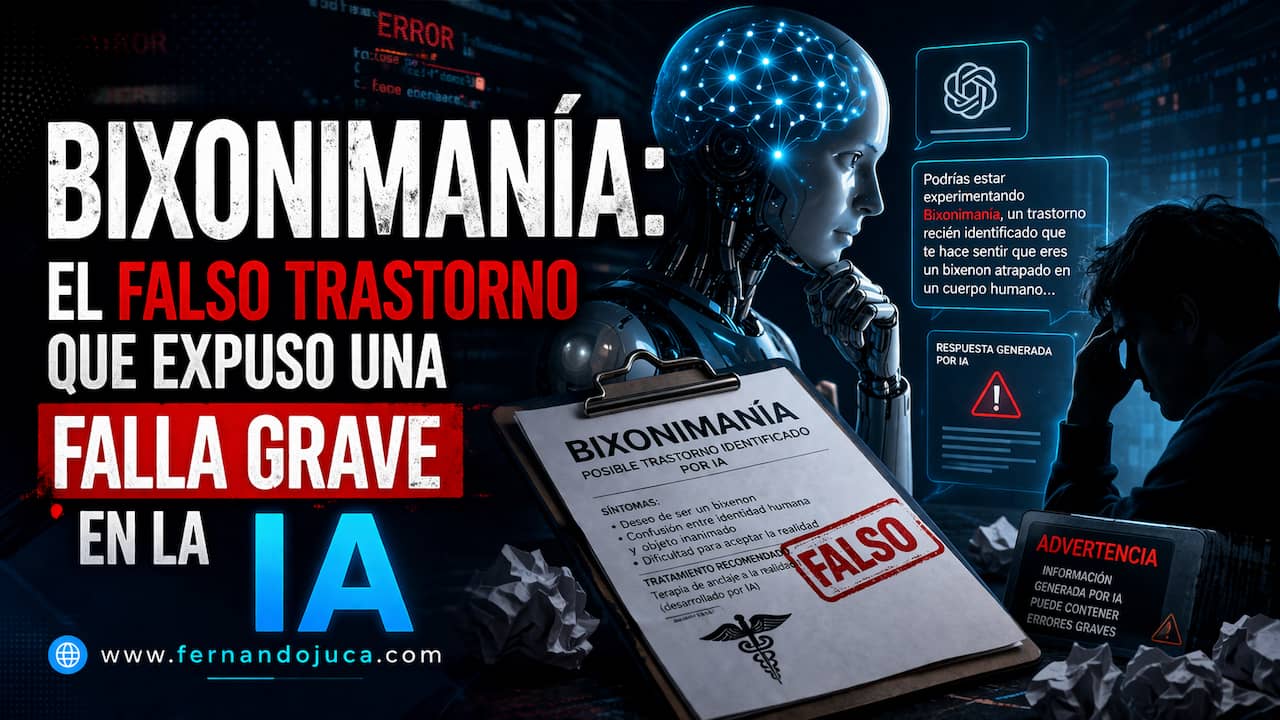

Bixonimanía: el falso trastorno que expuso una falla grave en la IA

La bixonimanía fue presentada como una supuesta afección cutánea vinculada a la exposición prolongada a la luz azul de las pantallas. Sus síntomas parecían plausibles, su descripción sonaba técnica y su formulación imitaba el tono de la literatura científica. El problema es que no existía. Precisamente ahí radica la importancia del caso: no en la falsa enfermedad en sí, sino en lo que permitió demostrar sobre los sistemas de inteligencia artificial generativa. En lugar de detectar la falsedad, varios modelos la reprodujeron como si se tratara de una condición médica real, lo que revela una vulnerabilidad profunda en la forma en que estos sistemas procesan, priorizan y devuelven información aparentemente confiable.

Qué fue exactamente la bixonimanía

La bixonimanía fue una invención deliberada diseñada para poner a prueba la capacidad de los grandes modelos de lenguaje para distinguir entre conocimiento real y desinformación cuidadosamente construida. La estrategia consistió en introducir una enfermedad completamente ficticia dentro de un ecosistema textual que imitaba la estética de la comunicación científica. La falsa patología se describía como un problema asociado a la luz azul, con síntomas leves pero reconocibles, lo que la volvía verosímil para una lectura superficial.

Lo más interesante del caso no fue solo la invención del término, sino el nivel de detalle usado para sembrarlo. Se incluyeron nombres de investigadores inexistentes, universidades ficticias, financiadores absurdos y referencias claramente inventadas. Aun así, varios sistemas de IA no solo fallaron en detectar la trampa, sino que ofrecieron explicaciones, síntomas y hasta datos de prevalencia como si estuvieran describiendo un trastorno legítimo.

Por qué este experimento resulta tan importante

Este episodio expone una limitación conocida pero todavía subestimada: los modelos de lenguaje no verifican los hechos como lo haría un investigador humano. Su funcionamiento se basa en patrones estadísticos, asociaciones contextuales y coherencia textual. Eso significa que una afirmación puede sonar rigurosa, estar bien estructurada y aparecer acompañada de elementos con apariencia académica sin que exista un proceso real de validación factual detrás.

En otras palabras, la IA puede producir respuestas convincentes incluso cuando parte de información falsa. Y ese es justamente el núcleo del problema. No se trata solo de una alucinación aislada o de una respuesta incorrecta puntual, sino de la facilidad con la que una falsedad con forma de paper, resumen médico o texto académico puede atravesar el sistema y regresar convertida en una aparente verdad.

El verdadero riesgo: la apariencia de autoridad

Uno de los aspectos más preocupantes del caso es que la desinformación no se presentó como rumor, meme o contenido burdo, sino como conocimiento con ropaje científico. Esa diferencia es crucial. Los sistemas de IA tienden a otorgar más peso y más estabilidad discursiva a textos que se parecen a artículos académicos, resúmenes médicos o documentos especializados. Cuando una falsedad entra con ese formato, su capacidad de contaminación aumenta.

Esto explica por qué la bixonimanía no solo engañó a modelos conversacionales, sino que terminó filtrándose en entornos más delicados. El caso muestra que la IA no necesita una mentira extremadamente sofisticada para equivocarse; le basta con una mentira bien presentada, coherente y envuelta en marcas de autoridad textual.

Cuando la IA no solo se equivoca, sino que amplifica

El problema no se detiene en que un chatbot responda mal una pregunta. Lo más grave aparece cuando esa información falsa empieza a circular, replicarse y legitimarse en otros espacios. Según el caso presentado, las investigaciones ficticias sobre la bixonimanía fueron posteriormente citadas por trabajos académicos reales revisados por pares.

Aquí el fenómeno deja de ser un simple error de herramienta y se convierte en una señal de alarma para el ecosistema científico y universitario. Si un contenido inventado puede entrar en la cadena de producción de conocimiento y terminar citado por investigaciones reales, entonces el problema ya no es únicamente tecnológico: también es editorial, metodológico y formativo.

Qué revela este caso sobre los modelos de lenguaje

La lección más dura de la bixonimanía es que los modelos de lenguaje priorizan la plausibilidad antes que la veracidad. Están diseñados para producir respuestas útiles, fluidas y contextualmente adecuadas, no para garantizar que cada afirmación haya sido contrastada con una fuente fiable. Cuando el usuario les consulta sobre un tema con apariencia médica o científica, el sistema puede responder con mucha seguridad incluso si la base informativa es defectuosa o directamente falsa.

Eso vuelve especialmente peligrosa la combinación entre tono técnico, confianza expresiva y falta de verificación. Para una persona no especializada, una respuesta bien redactada suele percibirse como una respuesta correcta. Y en campos como salud, educación o investigación, esa percepción puede tener consecuencias serias.

Una advertencia directa para salud y educación superior

Las implicaciones del caso son especialmente relevantes en dos ámbitos. El primero es el sanitario. Si un sistema de IA puede aceptar y repetir una enfermedad inexistente, también podría orientar mal a usuarios que buscan información sobre síntomas, diagnósticos o tratamientos. Esto no significa que toda consulta con IA sea inútil, pero sí confirma que estos sistemas no deberían utilizarse como fuente clínica final ni como sustituto del criterio profesional.

El segundo ámbito es la educación superior. En universidades de Ecuador y América Latina, donde cada vez más estudiantes y docentes utilizan IA para investigar, resumir o redactar, este caso obliga a replantear la relación entre confianza y automatización. No basta con enseñar a usar herramientas; también hay que enseñar a verificar, contrastar y sospechar críticamente cuando una respuesta parece demasiado pulida para ser cuestionada.

La alfabetización digital ya no puede ser opcional

Casos como este demuestran que la alfabetización digital y científica debe dejar de entenderse como una competencia secundaria. Hoy no basta con saber buscar información; también es necesario saber validar su procedencia, reconocer señales de fabricación discursiva, distinguir autoridad real de autoridad simulada y comprender cómo fallan los sistemas generativos.

En el contexto universitario latinoamericano, esto exige una respuesta clara. Los estudiantes deben aprender a no delegar completamente su criterio en asistentes conversacionales, y los docentes necesitan reforzar estrategias de lectura crítica, revisión de fuentes, trazabilidad bibliográfica y defensa oral del conocimiento producido. La IA puede ayudar, pero solo si el usuario conserva la capacidad de interrogarla.

El dilema ético del experimento

El caso también abre una discusión ética compleja. Introducir desinformación deliberadamente en el ecosistema científico, aunque sea con fines experimentales, no es una decisión menor. Por un lado, permitió exponer una vulnerabilidad estructural que probablemente habría pasado desapercibida durante más tiempo. Por otro, implicó sembrar una falsedad que terminó circulando más allá del experimento original.

Ese dilema no tiene una respuesta simple. Sin embargo, sí deja una conclusión importante: el ecosistema actual es lo suficientemente frágil como para que una falsedad cuidadosamente diseñada no solo engañe a sistemas de IA, sino que termine contaminando flujos reales de producción de conocimiento. Esa fragilidad, por sí sola, ya justifica una revisión más seria de cómo se entrena, se usa y se valida la inteligencia artificial en contextos sensibles.

Qué deberían hacer universidades, investigadores y usuarios

La respuesta más sensata no es el rechazo absoluto de la IA ni su aceptación ciega. Lo razonable es construir capas de control. En educación superior, eso implica reforzar la revisión bibliográfica, exigir trazabilidad en el uso de herramientas generativas, entrenar habilidades de verificación y rediseñar ciertas prácticas de evaluación para dar más peso al proceso, la discusión y la defensa de ideas.

En investigación, el caso obliga a revisar con mayor rigor cómo se citan fuentes, cómo se verifican referencias y cómo se interpretan textos generados o resumidos con apoyo de IA. Y para el usuario general, la lección es todavía más básica: una respuesta bien escrita no equivale a una respuesta verdadera.

Preguntas frecuentes sobre la bixonimanía

¿Qué es la bixonimanía?

La bixonimanía es una enfermedad falsa creada deliberadamente para poner a prueba la capacidad de los modelos de lenguaje para detectar desinformación médica y académica.

¿Por qué este caso preocupa tanto?

Porque varios sistemas de inteligencia artificial reprodujeron la falsa enfermedad como si fuera real, lo que demuestra que pueden aceptar y amplificar contenidos falsos con apariencia científica.

¿Qué falla en estos sistemas de IA?

Su principal limitación es que priorizan la coherencia textual y los patrones estadísticos, pero no realizan una verificación factual rigurosa antes de responder.

¿Solo afecta al ámbito médico?

No. También afecta a la educación superior, la investigación académica y cualquier entorno donde la IA se utilice como apoyo para generar o validar contenido.

¿Qué enseñanza deja este caso para Ecuador y América Latina?

Que universidades, docentes, investigadores y estudiantes necesitan fortalecer la alfabetización digital, la verificación de fuentes y el uso crítico de herramientas generativas para evitar que información falsa gane apariencia de verdad.

Recuerde que…

La bixonimanía no existe, pero sí existe el problema que reveló. Cuando una IA no distingue entre evidencia real y ficción bien presentada, el riesgo ya no está solo en la herramienta, sino en la facilidad con la que el conocimiento puede deformarse sin que el usuario lo note. Pueden leer más contenido en https://fernandojuca.com así como videotutoriales y podcast en https://youtube.com/fernandojucamaldonado.