Las grandes plataformas digitales utilizan cada vez más inteligencia artificial para detectar contenido ilegal o peligroso en internet. Uno de los casos más sensibles es la lucha contra el abuso infantil online, donde empresas tecnológicas colaboran con organismos de seguridad para identificar material ilegal y proteger a las víctimas.

Sin embargo, investigadores y agentes federales en Estados Unidos han alertado de que la inteligencia artificial de Meta diseñada para detectar estos casos podría estar fallando en un punto clave, lo que genera preocupación sobre la eficacia de estos sistemas automatizados.

Cómo se utiliza la IA para detectar abuso infantil

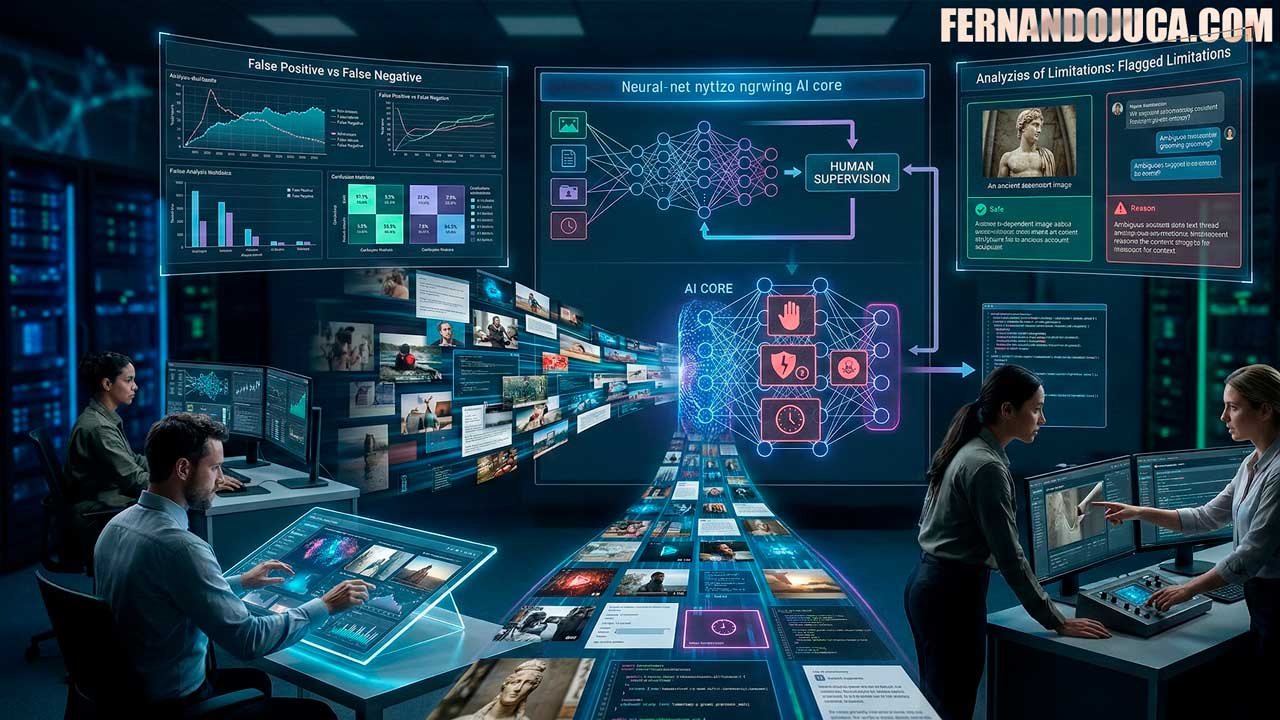

Las plataformas tecnológicas emplean sistemas de inteligencia artificial para analizar grandes cantidades de contenido y detectar posibles señales de abuso.

Estos sistemas pueden:

-

analizar imágenes y videos

-

detectar patrones sospechosos en mensajes

-

identificar comportamientos relacionados con explotación infantil

-

alertar a equipos humanos de moderación

El objetivo es acelerar la detección de material ilegal y permitir que los investigadores actúen con mayor rapidez.

El problema detectado por investigadores

Según agentes especializados en delitos contra menores, el sistema de inteligencia artificial de Meta podría estar fallando en la forma en que identifica ciertos tipos de contenido.

El problema principal es que algunos casos potencialmente peligrosos no estarían siendo detectados correctamente, lo que podría retrasar investigaciones o impedir que se identifiquen víctimas.

Los investigadores señalan que, aunque la IA puede ser una herramienta útil, no siempre es suficiente por sí sola para identificar este tipo de delitos complejos.

Por qué la detección automática es tan difícil

Detectar abuso infantil en internet es una tarea extremadamente compleja, incluso para sistemas avanzados de inteligencia artificial.

Entre los desafíos más importantes están:

-

el uso de códigos o lenguaje oculto

-

la adaptación constante de los criminales

-

la dificultad para interpretar contexto en mensajes

-

nuevas formas de compartir contenido ilegal

Estos factores hacen que la detección automática tenga limitaciones y que la supervisión humana siga siendo fundamental.

El papel de la supervisión humana

Los expertos coinciden en que la inteligencia artificial debe utilizarse como una herramienta de apoyo, no como la única línea de defensa.

Los sistemas de IA pueden ayudar a:

-

filtrar grandes volúmenes de contenido

-

priorizar casos sospechosos

-

detectar patrones repetidos

Pero las decisiones finales suelen requerir analistas humanos especializados que puedan evaluar el contexto de cada situación.

Qué significa esto para el futuro de la moderación con IA

El caso refleja un desafío más amplio en el uso de inteligencia artificial para moderar contenidos en plataformas digitales.

Aunque la tecnología ha mejorado mucho, aún existen limitaciones importantes cuando se trata de interpretar comportamientos humanos complejos.

Esto plantea preguntas clave sobre:

-

cómo mejorar los sistemas de detección

-

qué papel deben tener los moderadores humanos

-

cómo equilibrar privacidad y seguridad

A medida que las plataformas siguen creciendo, la combinación entre IA y supervisión humana será cada vez más importante.

Preguntas frecuentes sobre la IA y la detección de abuso infantil

¿Las plataformas usan inteligencia artificial para moderar contenido?

Sí. Muchas empresas tecnológicas utilizan sistemas de IA para detectar contenido ilegal o peligroso.

¿La inteligencia artificial puede detectar todo el contenido ilegal?

No. Aunque puede ayudar a identificar patrones sospechosos, la IA todavía tiene limitaciones.

¿Quién revisa los casos detectados por la IA?

Normalmente equipos humanos de moderación o investigadores especializados analizan los casos antes de tomar decisiones.

¿Se seguirá utilizando IA para este tipo de tareas?

Sí. A pesar de sus limitaciones, la inteligencia artificial permite analizar grandes volúmenes de contenido de forma mucho más rápida que los sistemas manuales.

RECUERDA QUE…

La inteligencia artificial se está convirtiendo en una herramienta clave para mejorar la seguridad en internet. Sin embargo, casos como este demuestran que la tecnología por sí sola no es suficiente, y que la supervisión humana sigue siendo fundamental para enfrentar problemas complejos.

Puedes leer más contenido sobre tecnología, inteligencia artificial y herramientas digitales en

https://fernandojuca.com

y ver videotutoriales y podcast en

youtube.com/fernandojucamaldonado.