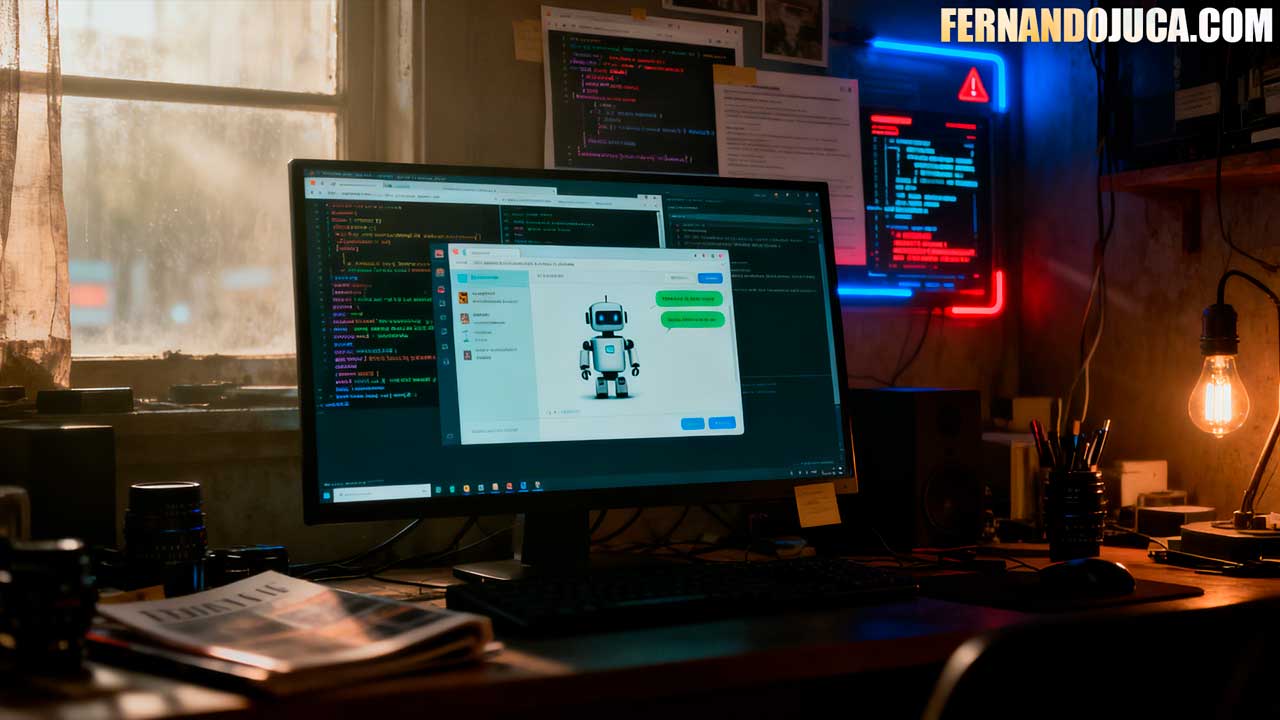

Envenenamiento de modelos de IA: el nuevo frente silencioso de la desinformación digital

La inteligencia artificial conversacional ha transformado la forma en que buscamos información. Sin embargo, esa misma capacidad de aprendizaje y síntesis la convierte en un objetivo atractivo para manipulaciones estratégicas.

El envenenamiento de modelos de IA consiste en introducir información maliciosa o sesgada dentro de los datos que los sistemas utilizan para generar respuestas. No se trata de hackear servidores tradicionales. Se trata de contaminar el conocimiento que el modelo interpreta como válido.

La amenaza no es visible. Es estructural.

¿Qué significa “envenenar” un modelo de IA?

El envenenamiento puede ocurrir cuando:

-

Se publican páginas web diseñadas para engañar sistemas de recopilación automática.

-

Se introducen datos falsos que aparentan autoridad.

-

Se manipulan fuentes con estructura optimizada para motores de búsqueda.

Si un modelo integra o consulta información contaminada, puede replicarla en sus respuestas.

La sofisticación del ataque no está en la complejidad técnica, sino en la manipulación estratégica del entorno informativo.

El rol de las páginas web maliciosas

Una simple página web puede convertirse en vector de desinformación si:

-

Simula ser fuente académica o institucional.

-

Presenta datos falsos con apariencia profesional.

-

Replica lenguaje técnico creíble.

Los sistemas de IA que analizan grandes volúmenes de información pueden interpretar ese contenido como legítimo si no existen filtros rigurosos.

La automatización acelera la difusión, pero también puede amplificar errores.

Desinformación en la era algorítmica

La desinformación tradicional dependía de viralidad humana. Hoy puede apoyarse en:

-

Optimización SEO manipulada.

-

Redes automatizadas de contenido falso.

-

Estructuras diseñadas específicamente para influir en sistemas de IA.

El problema no es solo que una persona lea información incorrecta. Es que un sistema automatizado la utilice como base para generar nuevas respuestas.

El error deja de ser individual. Se convierte en escalable.

Impacto en América Latina

En la región, donde la alfabetización digital no siempre acompaña la expansión tecnológica, el riesgo es doble:

-

Usuarios pueden confiar excesivamente en respuestas automatizadas.

-

Instituciones pueden carecer de marcos sólidos para evaluar fuentes.

La combinación de baja verificación crítica y alta confianza tecnológica crea vulnerabilidad estructural.

La formación en pensamiento crítico digital es urgente.

Seguridad algorítmica y responsabilidad corporativa

Las empresas que desarrollan modelos de IA implementan mecanismos de:

-

Filtrado de fuentes.

-

Evaluación de confiabilidad.

-

Supervisión humana.

Sin embargo, ningún sistema es infalible.

La velocidad de generación de contenido supera la capacidad de revisión manual completa.

La seguridad en IA debe evolucionar de manera constante.

Diferencia entre error y manipulación intencional

Un modelo puede cometer errores por:

-

Ambigüedad contextual.

-

Datos incompletos.

-

Limitaciones de entrenamiento.

Pero el envenenamiento es distinto. Implica intención deliberada de introducir sesgos o falsedades.

La amenaza es estratégica, no accidental.

Gobernanza y regulación

El fenómeno plantea preguntas clave:

-

¿Quién responde si una IA reproduce información manipulada?

-

¿Cómo se certifica la calidad de fuentes utilizadas?

-

¿Es necesario un estándar internacional de verificación?

La gobernanza de inteligencia artificial debe integrar ciberseguridad, ética y control de calidad informativa.

Educación y prevención

En entornos académicos y empresariales es necesario:

-

Enseñar verificación cruzada de información.

-

No asumir que una respuesta automatizada es definitiva.

-

Fomentar revisión de fuentes primarias.

La inteligencia artificial es herramienta poderosa, pero requiere usuario informado.

La automatización no sustituye criterio humano.

Recuerde que…

El envenenamiento de modelos de IA demuestra que la desinformación evoluciona junto con la tecnología. No basta con proteger sistemas contra intrusiones técnicas; también es necesario protegerlos contra manipulación informativa.

La confianza en herramientas digitales debe ir acompañada de pensamiento crítico, verificación constante y responsabilidad institucional.

FAQ

¿Qué es el envenenamiento de modelos de IA?

Es la introducción intencional de datos falsos o manipulados para influir en las respuestas generadas por sistemas de inteligencia artificial.

¿Puede hacerse con una simple página web?

Sí, si el contenido está diseñado estratégicamente para parecer fuente confiable y ser interpretado por sistemas automatizados.

¿Cómo pueden protegerse los usuarios?

Verificando información en múltiples fuentes y manteniendo criterio crítico frente a respuestas automatizadas.

¿Es un problema creciente?

Sí, debido a la expansión de sistemas de IA y la facilidad para crear contenido digital.