Actualmente, los deepfakes, o imágenes y videos falsificados mediante inteligencia artificial, se han convertido en una preocupación creciente. La capacidad de la IA para crear imágenes casi indistinguibles de la realidad plantea serios desafíos en términos de confianza y seguridad. Sin embargo, un grupo de investigadores ha encontrado una solución innovadora utilizando una técnica astronómica que lleva décadas en uso para medir galaxias. Esta técnica, aplicada ahora a la detección de deepfakes, promete ser una herramienta valiosa en la lucha contra la desinformación.

El Secreto de los Ojos: Una Técnica de la Universidad de Hull

Investigadores de la Universidad de Hull han desarrollado un método novedoso para detectar imágenes generadas por IA. La clave de esta técnica radica en los ojos de las personas en las imágenes y, específicamente, en la forma en que reflejan la luz. Esta investigación, liderada por el estudiante Adejumoke Owolabi y supervisada por el Dr. Kevin Pimbblet, profesor de astrofísica, utiliza una técnica astronómica para analizar la consistencia de la luz reflejada en los globos oculares.

Una Técnica Astronómica para Detectar Deepfakes

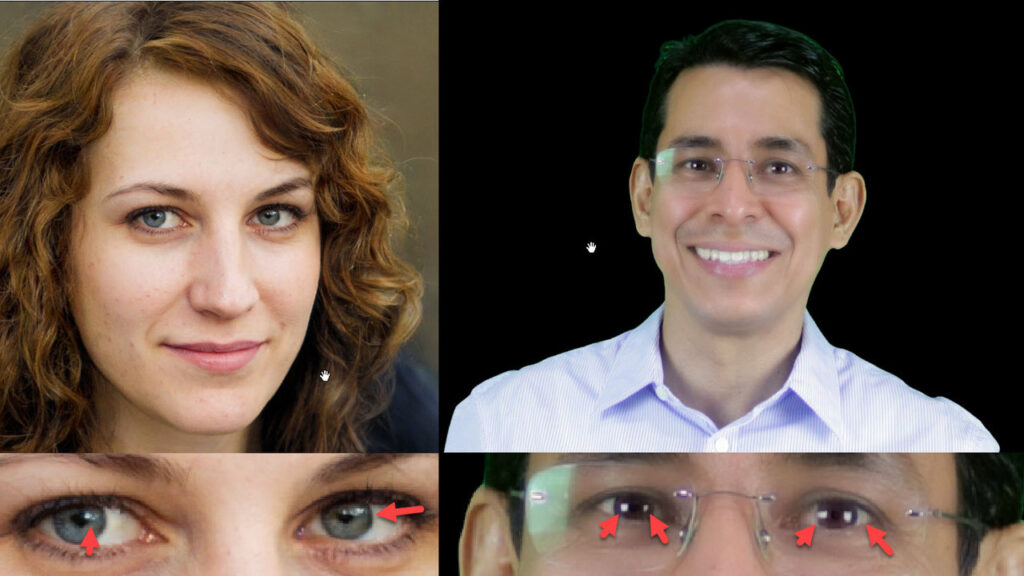

La técnica utilizada para detectar deepfakes está sorprendentemente basada en herramientas que los astrónomos han empleado durante años para estudiar galaxias. En lugar de analizar las estrellas y galaxias distantes, esta técnica se centra en la reflexión de la luz en los ojos de las personas en las imágenes. En una imagen real, los dos ojos reflejan la luz de manera similar. Sin embargo, en imágenes generadas por IA, estos reflejos suelen ser inconsistentes, ya que los algoritmos no siempre logran replicar este detalle con precisión.

El Coeficiente de Gini y la Detección de Inconsistencias

Para detectar estas inconsistencias, Owolabi desarrolló una técnica que analiza automáticamente las diferencias en los reflejos de la luz en los ojos. Utilizando el coeficiente de Gini, una medida tradicionalmente usada para evaluar la distribución de la luz en imágenes astronómicas, los investigadores pueden cuantificar la uniformidad de las reflexiones en los ojos. Esta herramienta permite evaluar si los reflejos en los globos oculares izquierdo y derecho son coherentes, identificando así las imágenes falsas generadas por IA.

Un Futuro en Evolución: Desafíos y Oportunidades

Aunque la técnica desarrollada por la Universidad de Hull es prometedora, enfrenta desafíos futuros. A medida que los creadores de deepfakes mejoren sus algoritmos, es probable que encuentren formas de corregir estas inconsistencias en los reflejos de la luz. No obstante, la detección de deepfakes seguirá siendo una carrera entre los desarrolladores de IA y los investigadores que buscan desenmascarar estas falsificaciones.

Alternativas: Marcas de Agua Invisibles

Además de las técnicas basadas en la reflexión de la luz, otra solución propuesta es la creación de marcas de agua invisibles en las imágenes generadas por IA. Estas marcas de agua podrían identificar claramente las imágenes como generadas por IA, proporcionando una manera más directa y posiblemente más efectiva de detectar deepfakes. Diversos movimientos están trabajando en esta dirección, y es posible que en el futuro estas marcas de agua se conviertan en una norma estándar para identificar contenido generado por IA.

La detección de deepfakes es un campo en rápida evolución que requiere soluciones innovadoras y adaptativas. La técnica astronómica desarrollada por los investigadores de la Universidad de Hull es un paso significativo en esta dirección, ofreciendo una herramienta efectiva para identificar imágenes falsas mediante el análisis de los reflejos de la luz en los ojos. Sin embargo, la lucha contra los deepfakes es continua, y el desarrollo de marcas de agua invisibles podría ofrecer una solución complementaria y robusta. En cualquier caso, es crucial seguir investigando y desarrollando nuevas técnicas para mantener la integridad y la confianza en el contenido digital.

Qué aporta realmente este avance

La técnica de Hull no solo aporta un detector puntual, sino una lección más amplia: la lucha contra los deepfakes probablemente necesitará combinar varias capas de defensa. Por un lado, análisis forense visual, como el de los reflejos oculares. Por otro, mecanismos de procedencia y trazabilidad como C2PA. Y, además, educación digital suficiente para que los usuarios no confíen ciegamente en lo que “parece real”. Esa combinación parece más robusta que apostar por una única tecnología salvadora. Esta última es una inferencia razonable a partir del estado actual de los métodos de detección y procedencia.

Preguntas frecuentes sobre cómo detectar deepfakes

¿Qué son los deepfakes?

Son imágenes, videos o audios manipulados o generados por inteligencia artificial para parecer reales. En muchos casos reproducen rostros, voces o gestos con un nivel de realismo muy alto.

¿Cómo ayuda la técnica de la Universidad de Hull a detectar deepfakes?

Analiza los reflejos de luz en ambos ojos y busca inconsistencias físicas entre el ojo izquierdo y el derecho. Si las reflexiones no son coherentes, eso puede indicar que la imagen fue generada por IA.

¿Qué es el coeficiente de Gini en este contexto?

Es una medida usada en astronomía para analizar cómo se distribuye la luz en una imagen. En esta investigación se aplicó a los reflejos oculares para evaluar si ambos ojos muestran una distribución compatible de la luz.

¿Este método detecta todos los deepfakes?

No. Los propios investigadores y la cobertura científica señalan que no es una herramienta infalible y que pueden existir tanto falsos positivos como imágenes sintéticas que eludan este patrón.

¿Las marcas de agua invisibles pueden ayudar a detectar imágenes generadas por IA?

Sí, como parte de sistemas de procedencia y autenticidad. Estándares como C2PA permiten incorporar metadatos y, opcionalmente, marcas de agua invisibles para ayudar a verificar origen y edición del contenido.

Recuerde que…

Detectar deepfakes no dependerá de una sola herramienta, sino de una combinación de análisis técnico, procedencia verificable y criterio humano. La técnica astronómica desarrollada en la Universidad de Hull demuestra que incluso los ojos pueden revelar inconsistencias que una imagen generada por IA todavía no siempre sabe esconder. Pueden leer más contenido en https://fernandojuca.com así como videotutoriales y podcast en https://youtube.com/fernandojucamaldonado.