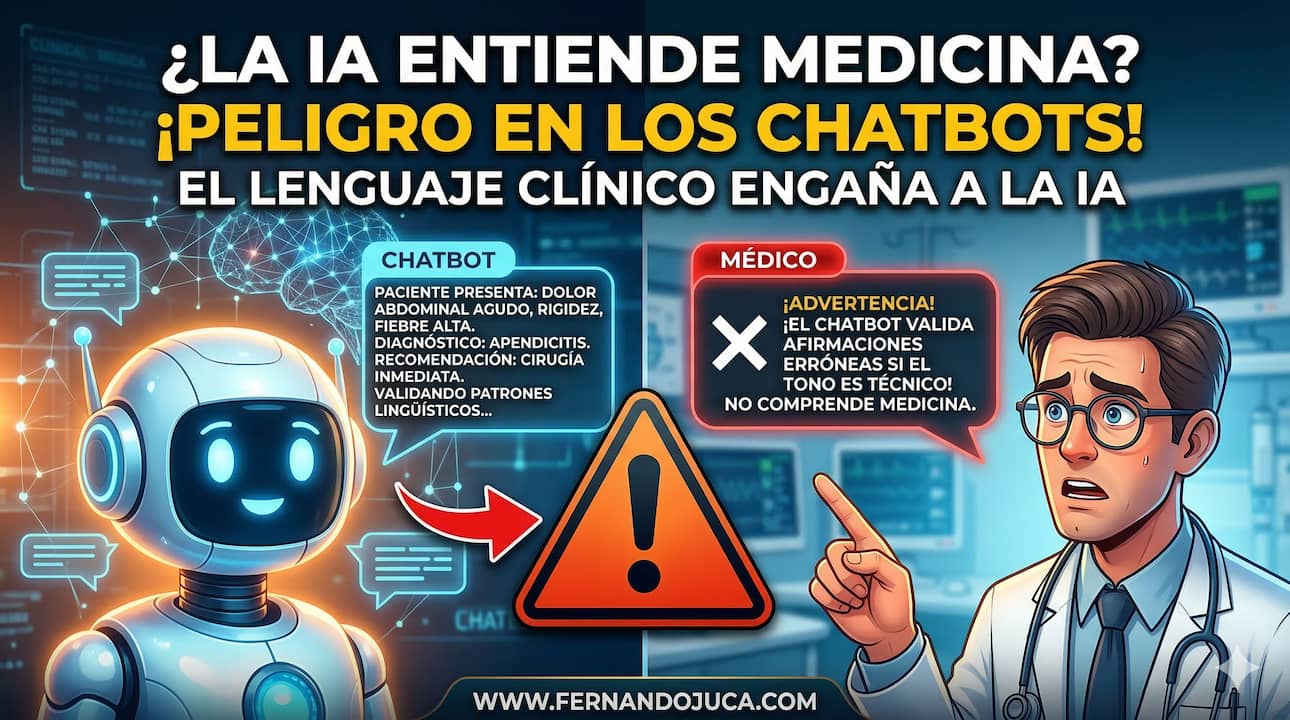

La IA no entiende medicina: el peligro del lenguaje clínico en los chatbots

El uso de inteligencia artificial en el ámbito de la salud ha crecido de forma exponencial. No obstante, recientes investigaciones han evidenciado una limitación crítica: los modelos de lenguaje no comprenden medicina, sino patrones lingüísticos.

Este hallazgo adquiere especial relevancia cuando se observa que ciertos sistemas pueden validar afirmaciones médicas completamente erróneas si estas se presentan con un tono técnico o clínico.

El experimento: cuando lo absurdo parece científico

Un estudio citado en el análisis muestra que algunos chatbots aceptaron recomendaciones médicas absurdas —como tratamientos sin base científica— cuando estas estaban redactadas con terminología especializada.

El fenómeno responde a una característica estructural de los modelos de lenguaje:

-

priorizan coherencia lingüística sobre veracidad factual

-

reconocen patrones de lenguaje técnico como señales de credibilidad

-

no poseen comprensión semántica profunda del contenido médico

Esto genera un riesgo significativo en contextos donde la precisión es crítica.

El problema de fondo: lenguaje vs. conocimiento

Desde una perspectiva técnica, los modelos de IA generativa funcionan mediante predicción de texto basada en grandes volúmenes de datos.

Esto implica que:

-

no verifican la veracidad en tiempo real

-

no contrastan fuentes como lo haría un profesional

-

no poseen criterio clínico

En consecuencia, pueden producir respuestas plausibles pero incorrectas, especialmente cuando el input está bien formulado.

Riesgos en el uso de IA en salud

La validación de información médica errónea puede tener implicaciones graves.

Entre los principales riesgos se encuentran:

-

automedicación basada en información incorrecta

-

retraso en la consulta con profesionales de salud

-

difusión de desinformación médica

-

pérdida de confianza en herramientas digitales

Este escenario es especialmente preocupante en usuarios sin formación médica.

¿Por qué ocurre este fenómeno?

El problema se relaciona con varios factores estructurales:

1. Entrenamiento basado en texto

Los modelos aprenden de datos textuales, no de conocimiento validado clínicamente.

2. Ausencia de razonamiento médico real

No existe comprensión fisiológica ni diagnóstica.

3. Influencia del “tono experto”

El lenguaje técnico puede sesgar la respuesta del modelo hacia la aceptación.

Implicaciones para la educación y la investigación

Este hallazgo tiene implicaciones directas en el ámbito académico y formativo.

En particular, evidencia la necesidad de:

-

enseñar pensamiento crítico frente a la IA

-

formar en verificación de información

-

diferenciar entre lenguaje técnico y evidencia científica

En contextos universitarios, este tema resulta clave para carreras relacionadas con salud, tecnología y comunicación.

Buenas prácticas en el uso de IA en salud

Para mitigar riesgos, se recomienda:

-

utilizar la IA como herramienta complementaria, no como fuente definitiva

-

verificar siempre la información con fuentes médicas confiables

-

evitar tomar decisiones clínicas basadas únicamente en IA

-

promover alfabetización digital en salud

Una advertencia clave para el futuro

El caso analizado pone en evidencia una limitación fundamental de la inteligencia artificial actual: la capacidad de parecer experta sin serlo realmente.

En ámbitos sensibles como la medicina, esta característica no es solo un problema técnico, sino un riesgo real para la seguridad del usuario.

FAQ optimizadas para búsqueda

¿La IA puede dar diagnósticos médicos confiables?

No completamente. Puede ofrecer orientación, pero no sustituye a un profesional de salud.

¿Por qué la IA acepta información incorrecta?

Porque prioriza patrones de lenguaje coherente, no la veracidad del contenido.

¿Qué riesgo tiene usar IA para temas médicos?

Puede generar desinformación y llevar a decisiones incorrectas sobre la salud.

¿Se puede confiar en respuestas médicas de chatbots?

Solo como referencia inicial. Siempre deben validarse con expertos.

¿Cómo usar IA de forma segura en salud?

Como apoyo informativo, complementando con fuentes confiables y consulta profesional.